Περιεχόμενα

Όλοι το έχουμε σχολιάσει, συζητήσει. Αρκετοί έχουμε μπει σε διαδικασία να «τσατάρουμε» μαζί του, θέλοντας να δούμε από πρώτο χέρι πόσο έξυπνο είναι, βρε παιδί μου, αυτό το «ρομπότ». Λιγότερο από τρεις μήνες στη (ψηφιακή) ζωή μας και το ChatGPT της Microsoft γεννά μεγάλους προβληματισμούς, ανοίγει παράθυρο σε κατοπινούς καιρούς. Τι μας φέρνει άραγε αυτός ο «φίλος» από το μέλλον; Μια πρώτη εικόνα από μια επερχόμενη τεχνολογική επανάσταση που θα μας λύσει τα χέρια με μυριάδες νέους τρόπους που ούτε καν μπορούμε να φανταστούμε; ‘Η στρώσαμε μόνοι μας ως είδος το έδαφος για την καταστροφή μας; Το ‘χουμε άλλωστε αυτό οι άνθρωποι, είμαστε ικανοί για θαύματα, αλλά και για το χειρότερο.

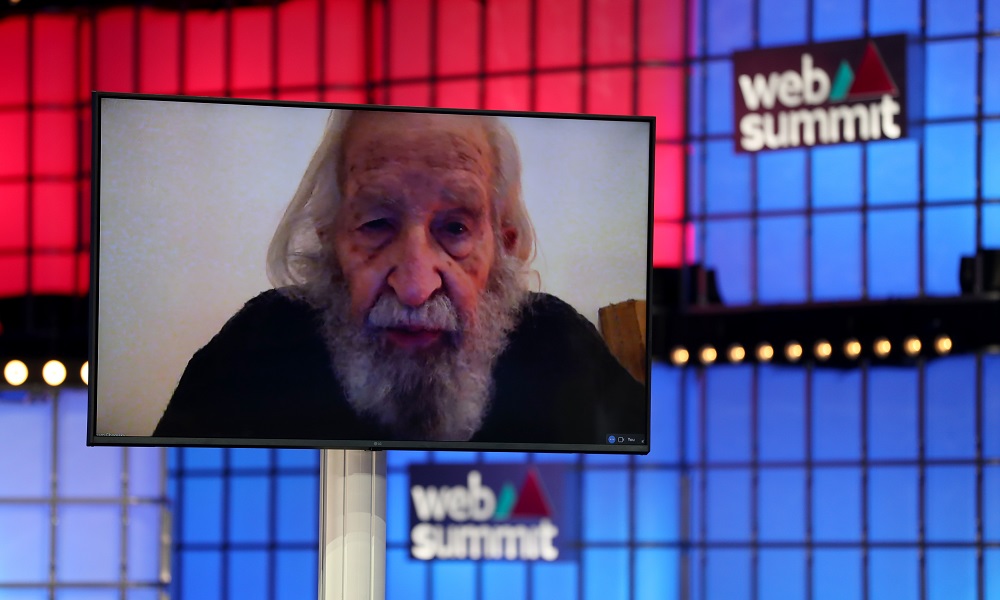

Κατά τον Νόαμ Τσόμσκι πάντως, δεν έχουμε λόγο να φοβόμαστε, να απειλούμαστε. Ακόμα, τουλάχιστον. Το άρθρο του μεγάλο αυτού διανοούμενου των καιρών μας στους New York Times, που συνυπογράφει με τους Ian Roberts (καθηγητής γλωσσολογίας) και Jeffrey Watumull (διευθυντής τεχνητής νοημοσύνης), έρχεται να δώσει μια αρκετά κατηγορηματική απάντηση επί του ακανθώδους αυτού ζητήματος.

Με το καλημέρα, ο τίτλος («Η ψεύτικη υπόσχεση του ChatGPT») σε βάζει στο πνεύμα για το τι θα διαβάσεις. Μετά, θέλει προσοχή. Μεγάλη. Δεν τα λέει εύκολα ο Τσόμσκι. Ποτέ δεν τα έλεγε. Αλλά έχει το ταλέντο της μεταδοτικότητας. Εκλαϊκεύοντας κατά το δυνατόν τη γνώση του, με μια καθαρότητα σκέψης που εντυπωσιάζει – ο άνθρωπος αυτός είναι 94 ετών, αλλά το μυαλό του δουλεύει ακόμα με άπειρες στροφές το δευτερόλεπτο.

Γιατί κατά τον Τσόμσκι προγράμματα όπως το ChatGPT είναι ακόμα πολύ πίσω σε σχέση με τον άνθρωπο

Αν έπρεπε να προτάξουμε μια και μόνο πρόταση του άρθρου, θα ‘ταν η εξής: «Το ανθρώπινο μυαλό δεν είναι, όπως το ChatGPT και τα όμοιά του, μια βαρετή στατιστική μηχανή αντιστοίχισης μοτίβων». Και σε μια πιο ευρεία προσέγγιση ελεύθερης απόδοσης του νοήματος, πως η (συγκεκριμένη) τεχνητή νοημοσύνη θα είναι πάντα μια συγκριτικά πρωτόγονη και κατώτερη μορφή σκέψης σε σχέση με την ανθρώπινη.

Δεν έχουμε δηλαδή φτάσει σε στάδιο εκπλήρωσης της δυστοπικής προφητείας ενός διαχρονικού φόβου μας ως είδος. Τουτέστιν σε εκείνη στιγμή που οι μηχανές θα νικήσουν τον ανθρώπινο εγκέφαλο «όχι μόνο ποσοτικά ως προς την ταχύτητα επεξεργασίας και το μέγεθος μνήμης αλλά και ποιοτικά όσον αφορά την πνευματική διορατικότητα, την καλλιτεχνική δημιουργικότητα και κάθε άλλη ξεχωριστή ανθρώπινη ικανότητα».

Αυτή η μέρα μπορεί να έρθει κάποια στιγμή, αλλά ακόμα δεν είμαστε καν στην αυγή αυτής, κατά τον Τσόμσκι. Κόντρα σε όσα γράφονται με υπερβολικούς πηχυαίους τίτλους. Εν αρχή απουσιάζει η ικανότητα για δημιουργία εξηγήσεων παράλληλα με τη συσχέτιση δεδομένων: «Είναι κωμικοτραγικό να ξοδεύονται τόσο πολλά χρήματα σε τέτοια προγράμματα. Το βαθύτερο ελάττωμά τους είναι η απουσία της πιο κρίσιμης ικανότητας οποιασδήποτε νοημοσύνης: να λένε όχι μόνο τι ισχύει, τι συνέβη και τι θα συμβεί – αυτό είναι περιγραφή και πρόβλεψη – αλλά και τι δεν ισχύει και τι θα μπορούσε και δεν θα μπορούσε να ισχύει. Αυτά είναι τα συστατικά της εξήγησης, το σημάδι της αληθινής νοημοσύνης».

Και επίσης: «Η αληθινή νοημοσύνη είναι ικανή για ηθική σκέψη. Αυτό σημαίνει να περιορίσουμε την κατά τα άλλα απεριόριστη δημιουργικότητα του μυαλού μας με ένα σύνολο ηθικών αρχών που καθορίζουν τι πρέπει και τι όχι (και φυσικά υποβάλλοντας αυτές τις αρχές σε δημιουργική κριτική). Για να είναι χρήσιμο, το ChatGPT πρέπει να εξουσιοδοτηθεί να παράγει νέα αποτελέσματα. Για να είναι αποδεκτό από τους περισσότερους χρήστες του, πρέπει να αποφεύγει ηθικά απαράδεκτο περιεχόμενο. Αλλά οι προγραμματιστές του ChatGPT παλεύουν – και θα συνεχίσουν να παλεύουν – για να επιτύχουν αυτό το είδος ισορροπίας».

Το ζήτημα είναι κατασκευαστικό και στη βάση του, κωμικοτραγικό

Ο Τσόμσκι και οι συνεργάτες του πέρασαν από διάφορα τεστ την ΑΙ με ερωτήσεις-παγίδες, μέσω των οποίων φάνηκε το πρόβλημα της ηθικής αδιαφορίας που γεννά ακριβώς η έλλειψη πραγματικής νοημοσύνης. Το ChatGPT έγινε η «κοινοτοπία του κακού»: Λογοκλοπή, απάθεια και τελικά αποστασιοποίηση. Παπαγαλίζοντας, μην παίρνοντας θέση, επικαλούμενο όχι απλώς άγνοια αλλά έλλειψη ευφυΐας και τελικά υπερασπιζόμενο τον «εαυτό» του λέγοντας πως απλώς ακολουθεί εντολές και ότι την ευθύνη την έχουν αυτοί που το έφτιαξαν.

Και ποιο το συμπέρασμα του άρθρου; «Το ChatGPT και τα όμοιά του δεν είναι κατασκευαστικά σε θέση να εξισορροπήσουν τη δημιουργικότητα με τους περιορισμούς. Δεδομένης της ανηθικότητας, της ψευδοεπιστήμης και της γλωσσικής ανικανότητας αυτών των συστημάτων, δεν μπορούμε παρά να γελάσουμε ή να κλάψουμε με τη δημοτικότητά τους».

Ναι. Το ανθρώπινο μυαλό είναι καταπληκτικό. Δεν είμαστε πάντα άψογοι- εννοείται. Αλλά αυτό είναι μέρος του τι σημαίνει να σκέφτεσαι. Για να έχεις δίκιο, πρέπει να είναι πιθανό να κάνεις λάθος. Αναζητούμε εξηγήσεις, ψάχνουμε να διορθώσουμε τα λάθη μας. Η τεχνητή νοημοσύνη προς ώρας είναι περισσότερο μηχανή απομνημόνευσης. Παίρνει τεράστιες ποσότητες δεδομένων, ψάχνει για μοτίβα σε αυτά και γεννά στατιστικά πιθανά συμπεράσματα με εξαιρετική παραγωγικότητα. Αδυνατεί όμως να ξεχωρίσει το πιθανό από το απίθανο.

Μάλλον το πιο εντυπωσιακό αυτή τη στιγμή δεν είναι η τεχνητή νοημοσύνη αυτή καθαυτή, αλλά η ταχύτητα επεξεργασίας ενός τεράστιου όγκου ψηφιακών δεδομένων. Ένα θαύμα της τεχνολογίας. Αρκετά μακριά ωστόσο από οτιδήποτε νοήμων. Σαν μια πιο προηγμένη μηχανή αναζήτησης της Google, θα μπορούσαμε να συνοψίσουμε.

Μήπως όμως γίνουμε τεμπέληδες και σταδιακά «χαζοί»;

Παρεμπιπτόντως, ο Τσόμσκι πρόσφατα, σε μια άλλη ανοιχτή συζήτηση είχε υποστηρίξει πως η τεχνητή νοημοσύνη είναι στην πραγματικότητα… τεχνητή παπαγαλία. Κι ως τέτοια δεν πρέπει μας προξενεί μεγάλη ανησυχία. Ο μεγαλύτερος κίνδυνος είναι να μας κάνει τεμπέληδες. Θα είναι πολύ δύσκολο να εντοπίσεις τη (high-tech) λογοκλοπή στο μέλλον ως καθηγητής. Θα αλλάξει η παιδαγωγική μέθοδος και οι εκπαιδευτικές πρακτικές, θα κάνει τα παιδιά να πάψουν να ψάχνουν, να μη γράφουν οι ίδιοι τις εργασίες τους – ποιος ο λόγος όταν θα έχουν τη δυνατότητα να τα βρίσκουν όλα έτοιμα με το πάτημα ενός κουμπιού;

Αν όμως πάψουμε να σκεφτόμαστε, να βάζουμε τον εαυτό μας να στύψει το μυαλό του για να βρει λύσεις, μήπως αυτό δεν θα είναι ήττα μας ως είδος; Μήπως έτσι γίνουμε «χαζοί» χωρίς να το καταλάβουμε; Τροφή για σκέψη και συζήτηση, ακόμα μία…